AI 只係模擬,唔係思考

Bloom’s Taxonomy 最底兩層「記憶」、「理解」AI 已經完勝。值得留意嘅係,AI 同人嘅理解方式,係兩回事。

哲學家 John Searle 喺 Chinese Room Argument(中文房間論證)解釋得好清楚。想像一個唔識中文嘅人坐喺房入面,你遞一張中文紙條入嚟。房入面有本英文手冊,教房入面嘅人「見到呢啲符號,就抄返果啲符號出去」,之後你會收返一張「中文」紙條。只要本手冊足夠齊全,你就會覺得佢「識中文」。而佢只係跟規則砌符號,完全唔明、亦唔駛明自己寫緊咩。

結論係:編程計算機可能使其看起來理解語言,但無法產生真正的理解。理解必須源於生物過程,而唔係純粹嘅符號操作,直接劍指 AI。AI 可以「完美」咁寫 email、寫報告、寫 code,但佢唔知自己寫緊咩、更唔知邊啲係真、邊啲係假。佢只係跟 pattern 砌字,冇真正嘅 understanding(理解)。呢個分別,喺 Apply(應用)同 Analyze(分析)層開始出事。AI 可以做到好多嘢,但你唔把關,就會爆鑊。更重要嘅,如果有鑊,係你自己食。

工作可以外判,責任唔可以

舊年(爭啲打左今年,所以決定 play safe)2025 年 7 月,Deloitte 交咗份報告俾澳洲政府,237 頁,收成 30 萬美金。報告評估澳洲政府福利系統 IT 架構,睇落好專業。去到 10 月,有學者發現報告入面有唔少虛構引述、句括論文、法官判詞、研究,甚至「專家」都有假。Deloitte 最後承認咗用 AI 幫手寫 draft,但冇 proofread 就交貨。

結果?0分重做、退錢、公開道歉、衝出國際。

唔想成為下一個衝出黎嘅人

唔好淨係拋句「幫我寫」,而係要俾清晰 context。例如你要講清楚:做緊咩?要達到咩效果?「解釋技術問題但要客戶聽得明」,提供已知事實:有咩數據?有咩限制?(之類)。最後你要劃清界線:要講咩、唔可以講咩(更重要)?例如「唔好引用未經 verify 嘅數據」、「唔好用太 formal」。

你將自己嘅專業注入去,AI 先可以幫你做到專業嘅嘢。如果你連想要咩都講唔出,AI 就會出垃圾畀你(AKA Garbage In, Garbage Out)。當 AI 係全能都好,你都要問啱問題,先有啱答案。

之後就係要 fact check。如果 AI 話「根據 2024 年 XYZ 研究」,你要睇下呢個研究係咪真係存在、AI係咪講緊真嘢。所有數字係咪啱?AI 好習慣性「估」一個「聽落合理」嘅數字。你要對返原始數據,confirm 每個數字。語氣係咪符合你想傳達嘅訊息?AI 可能太 formal、或者太 casual、唔夠真誠,AI 只係模擬,佢唔知自己做緊啱定錯。

分析?搞清楚!AI 本質係靠估

Analyze(分析)係拆解資訊、搵關係、做比較。AI 可以幫你分類資料、做對比表、提出可能原因。你慳返幾個鐘甚至幾日。但問題係,AI 本質係靠估。AI 睇過海量文字(幾千億個字),學識咗「邊啲字通常跟邊啲字」 pattern 。當你問佢問題,佢唔係去 database 查答案,而係用統計學「估」下一個 token(字詞)應該係咩。

去返 Chinese Room Argument,唔識中文嘅人,只要手上有本超級詳細嘅手冊(訓練數據),教佢「見到呢啲符號,通常跟住會出現果啲符號」。佢可以好流暢咁「對話」,但佢其實冇真正理解自己講緊咩。呢個就係 Neural network (神經網路,AI 大幅度使用嘅機器學習方法,我會開一個獨立系列畀佢)嘅操作方式,基於 probability(概率),而唔係 truth(真相)。即係話,佢會出個「統計上最有可能」嘅答案俾你,但唔代表係啱。

AI 點解會有 Hallucination(幻覺):《賭俠》「電腦分析」有咩啟示

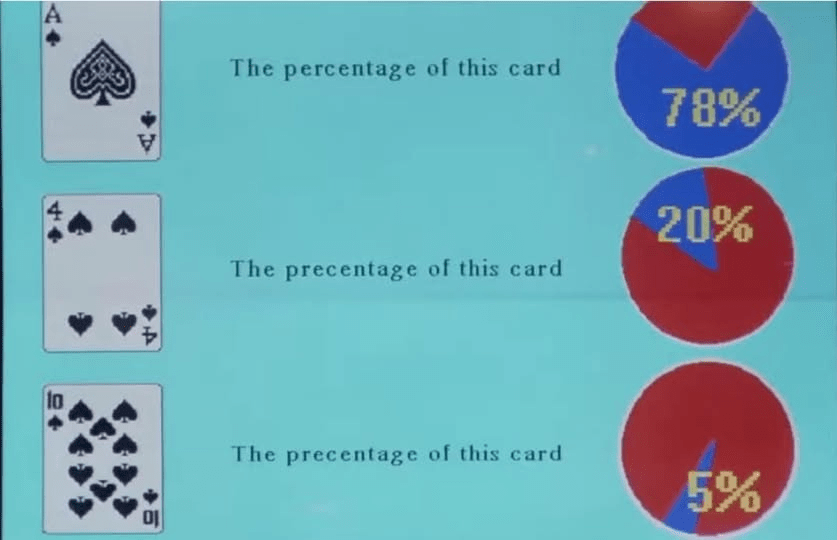

記唔記得《賭俠》入面,「電腦分析,65% 係 7,35% 係 JACK,唔係 7 就係JACK」其實係睇牌角靠估。而呢度,黎到另一個經典:78% +20% +5% =103%。

點解會咁?當然,係大家Check 漏左張Power Point。「電腦分析」呢?佢唔係估,而係真係靠估,佢可以唔識「三個數加埋一定要係 100%」呢個數學概念,佢只係「估」緊「呢啲數字睇落合理」。更大鑊嘅係,AI 唔會話你知「我估緊」,會用好專業、好自信嘅方式出答案,好似真係計過咁。正如 Chinese Room 咁,房外面嘅人會覺得佢「識中文」,但其實佢連自己寫緊咩都唔知。

呢個就係 AI hallucination(幻覺):一啲「聽落好有道理」但其實係錯或者作出嚟嘅嘢。佢只係跟 pattern 砌,冇真正理解過,而且佢絕少講「我唔識」。

AI 都有野唔識?唔識講「我唔識」

AI 手上有本超級無敵嘅手冊(訓練數據),但偏偏就係冇「我唔識」,就算手冊入面有,AI 都好少會用。點解?因為 neural network 嘅目標係「生成最有可能嘅下一個字」,唔係「答案正確」。當佢唔肯定,最有可能答「我唔知」,定係「估」返一個「最有可能嘅」答案出嚟。大部分情況下,AI 會揀後者,因為訓練數據入面,「提供答案」嘅情況遠遠多過「唔知」。

而且,自信嘅語氣都係一個「最可能」,因為訓練數據入面,專業答案係用自信語氣寫,定係話自己唔肯定?即係話,AI 會傾向用好專業、好肯定嘅語畀個「答案」你,而唔係講唔肯定。結果就係,認真便輸了,好似 Deloitte 咁。佢可以好快出一個「似樣」嘅答案,但呢個啱唔啱、有冇漏、會唔會出事,呢啲係你嘅責任,唔係 AI 嘅。

記住腦袋是個好東西

Chinese Room 提醒咗我哋:模擬同思考之間,有條好深嘅鴻溝。AI 可以完美咁砌答案,但佢冇真正嘅理解、更加唔會為自己嘅 output 負責。上面嘅案例唔係話「唔好用 AI」,而係:模擬同思考之間嘅空間,就係你嘅價值所在。AI 可以幫你做粗重功夫,但人要把關。AI 只係工具,而你先至係負責果個。

我哋之後會去到關鍵部分:Evaluate(評估)Written WITH AI 同 Written BY AI 最重要分水嶺。AI 可以幫你記、理解、應用、甚至分析,但 AI 做唔到基於道德、責任、情境、專業判斷嘅真正評估,只有人類做到。而呢個,先至係人類最後嘅堡壘。